Когда я начинал заниматься машинным обучением, имея опыт работы в информатике, мне всегда требовалось время, чтобы понять статистические концепции и вспомнить, что я узнал во время учебы. Однако я также пришел к выводу, что чем яснее мои основы, тем легче мне понять стоящую передо мной проблему.

На пути к машинному обучению есть несколько чрезвычайно важных вех, которые необходимо достичь, чтобы ускорить свой путь. Одна из таких вех - вероятность и условная вероятность. В этой статье мы быстро рассмотрим основы теории вероятностей, перейдем к условной вероятности и, наконец, рассмотрим теорему Байеса. Мы также рассмотрим несколько примеров для изучения приложений теоремы Байеса.

Шаг 1. Вероятность

Напомним некоторые основные вероятности. Например, у нас есть коробка, Коробка А перед нами. В нем 6 кусочков мела и 5 кусочков сыра.

Вероятность того, что я выберу мел, = Общее количество мелков / Общее количество предметов = 6/11

Следовательно, P (Chalk) = 6/11. Точно так же P (сыр) = 5/11.

Попробуем вытащить еще один элемент из коробки с условием.

Какова вероятность того, что я выберу сыр из коробки, если я уже выбрал мел? Могу ли я рассчитать это по приведенной выше формуле? Нет.

Здесь на помощь приходит условная вероятность.

Шаг 2: условная вероятность

Взяв приведенный выше пример, мы можем разделить проблему на 2 части.

1. Часть 1: если я уже выбрал мел

2. Часть 2: Вероятность того, что я выберу сыр.

Таким образом, Часть 1 - это условие, а Часть 2 - это вероятность. Это называется условной вероятностью.

Обозначение: P (выбор сыра | при условии, что я уже выбрал мел).

Следовательно, по правилу умножения

P (выбор сыра | учитывая, что я уже выбрал мел) = 5/10

Давайте расширим эту проблему дальше. Какова вероятность выбрать в таком порядке мел и сыр?

P (мел и сыр) = P (мел) * P (сыр | мел) = 6/11 * 5/10 = 6/22

Если вы вспомните, это правило умножения для 2 взаимозависимых событий A и B.

Давайте теперь попробуем вывести формулу условной вероятности, используя наш пример с мелом и сыром.

Мы вывели формулу условной вероятности.

Давайте еще раз рассмотрим этот пример и добавим еще одну коробку B с тем же количеством мелков и сыров, что и в коробке A.

Теперь, когда у нас есть 2 коробки, и я выбираю мел, какова вероятность, что я выбрал этот мел из коробки B?

Этот ответ можно получить с помощью теоремы, называемой теоремой Байеса.

Шаг 3: теорема Байеса

Часть 1

Взяв указанную выше проблему, давайте вычислим еще несколько вероятностей.

1. P (ячейка A) = 1/2

2. P (ячейка B) = 1/2

3. P (Мел | Коробка A) = P (Мел из коробки A) * P (Коробка A) = 5/11 * 1/2 = 5/22

Сходным образом,

4. P (Мел | Коробка B) = P (Мел из коробки B) * P (Коробка B) = 5/11 * 1/2 = 5/22

Затем давайте сделаем таблицу, чтобы упорядочить то, что мы знаем:

Часть 2

Возвращаясь к нашему вопросу: если у нас есть 2 коробки, и я выбираю мел, какова вероятность, что я выбрал этот мел из коробки B?

Чтобы упростить эту постановку задачи, я должен вычислить вероятность того, что коробка находится в коробке B, учитывая, что я выбрал мел. В наших обозначениях для условной вероятности это P (Box B | Chalk)

Из нашей формулы условной вероятности

Часть 3

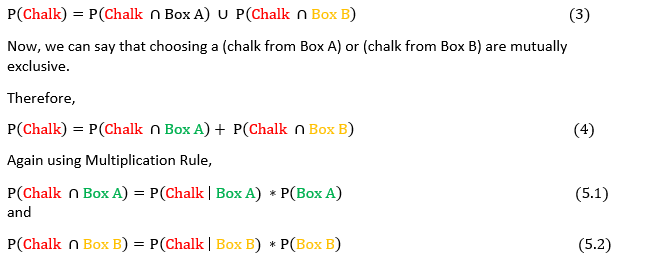

Как получить P (мел)? Мы можем выбрать мел двумя способами. Выбранный объект может быть (мел из коробки A) или (мел из коробки B).

Следовательно,

Подставляя значения (5.1) и (5.2) в наш знаменатель из (2),

Точно так же мы можем узнать следующее:

1. Если я выбираю мел, какова вероятность, что он находится в графе A?

2. Если я выбираю сыр, какова вероятность, что он находится в ячейке A?

3. Если я выбираю сыр, какова вероятность, что он находится в ячейке B?

Попробуйте их!

Если мы посмотрим на таблицу и ответ, который мы получили выше, мы увидим, что мы уже знали P (Chalk | Box B) и вычислили P (Box B | Chalk). По сути, мы изменили то, что знали, и то, что хотели узнать.

Вероятности из 1-го столбца, которые дают P (мел) из поля A и P (мел) из поля B, называются априорными вероятностями. так как мы их заранее знали / рассчитывали. Вычисленные нами вероятности, такие как P (Box B | Chalk), называются апостериорными вероятностями, поскольку мы рассчитали их после получения дополнительной информации.

Попробуем получить общую формулу из наших расчетов выше.

Более подробную информацию о нем можно найти здесь: https://en.wikipedia.org/wiki/Thomas_Bayes

Эта теорема чрезвычайно важна для большого числа более сложных теорем и используется в одной из наиболее широко используемых методов классификации, называемой наивной-байесовской классификацией.

Теорема, а также априорная и апостериорная вероятности, которые мы получаем, используются для расширения их до гипотезы и свидетельств модели. Это называется байесовским выводом. Теорема также вдохновила статистическую философию, называемую байесовской статистикой.

Таким образом, мы увидели 3 шага к изучению теоремы Байеса. В следующей части мы рассмотрим набор данных и применим вышеупомянутую теорему и условные вероятности, чтобы увидеть ее на практике.

Спасибо за прочтение!