Линейная регрессия делает прогнозы для непрерывных/реальных или числовых переменных, таких как продажи, зарплата, возраст, цена продукта и т. д.

Линейная регрессия выполняет задачу прогнозирования значения зависимой переменной (y) на основе заданной независимой переменной (x). Итак, этот метод регрессии обнаруживает линейную зависимость между x (вход) и y (выход). Отсюда и название — линейная регрессия.

В терминах геометрической интерпретации алгоритм линейной регрессии пытается найти плоскость или линию, которая лучше всего соответствует точкам данных.

Что означает термин «поиск плоскости, которая лучше всего соответствует точкам данных»?

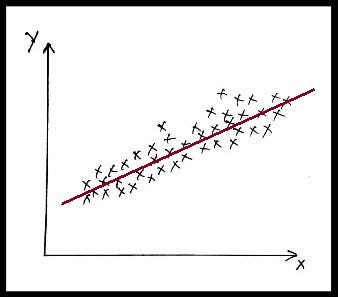

Изображение 1: Представление образца двумерного набора данных

Для приведенного выше примера двухмерного набора данных (изображение 1) общее уравнение линии, покрывающей максимально возможное количество точек, имеет вид y = mx+c, где m — наклон линии, а c — точка пересечения. срок. Алгоритм линейной регрессии пытается найти линию/плоскость, для которой функция стоимости минимизируется.

Представим приведенное выше уравнение плоскости в виде y = w1*x + b

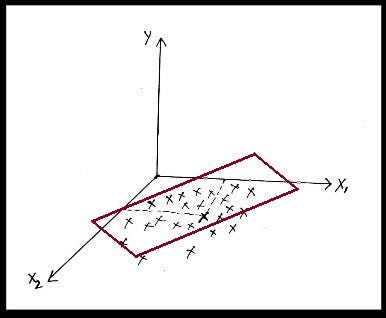

Изображение 2: Представление образца трехмерного набора данных

Точно так же для примера трехмерного набора данных (рис. 3) уравнение плоскости, которое лучше всего соответствует максимально возможному количеству точек, имеет вид y = w1x1 + w2x2 + b.

То же уравнение можно расширить для набора данных d-измерения:

Итак, нам нужно найти плоскость (W, b) приведенного выше уравнения, которая лучше всего соответствует большинству точек данных.

Подбор лучшей линии пересечения

Линия наибольшего соответствия наилучшего соответствия – это прямая линия, представляющая наилучшее приближение графика рассеяния точек данных. Он используется для изучения характера взаимосвязи между этими точками.

Уравнение для нахождения наилучшей подходящей линии:

Y` = bX + A

где Y`обозначает прогнозируемое значение

b обозначает наклон линии

X обозначает независимую переменную

A - перехват Y

На диаграмме заданный набор точек данных будет отображаться в виде точечной диаграммы, которая может быть организована или не организована вдоль какой-либо линии. Можно провести много прямых линий через точки данных на диаграмме, но найти линию наилучшего соответствия, которая сводит к минимуму расстояние этих точек от этой линии, является одним из наиболее важных результатов регрессионного анализа.

Итак, как нам найти линию наилучшего соответствия с помощью регрессионного анализа?

Обычно кажущаяся предсказанная линия наилучшего соответствия может быть не совсем правильной, что означает, что она будет иметь «ошибки прогнозирования» или «остаточные ошибки».

Прогноз или остаточная ошибка — это не что иное, как разница между фактическим значением и прогнозируемым значением для любой точки данных. В общем, когда мы используем Y` = bX +A для предсказания фактического ответа Y`, мы делаем ошибку предсказания (или остаточную ошибку) размером:

E = Y — Y`

где E обозначает ошибку прогнозирования или остаточную ошибку.

Y`обозначает прогнозируемое значение

Y обозначает фактическое значение

Линия, которая соответствует данным «наиболее», будет такой, для которой ошибки прогнозирования (одна для каждой точки данных) минимальны. >

На приведенной ниже диаграмме показано простое представление со всеми обсуждаемыми выше значениями:

Регрессионный анализ использует метод наименьших квадратов для построения наилучшей линии. Этот метод строит линию, которая минимизирует квадрат расстояния каждой точки от линии наилучшего соответствия.

Поиск «Линии наилучшего соответствия» с использованием метода наименьших квадратов

Наиболее популярным и распространенным методом, который используется в регрессионном анализе для построения наилучшей линии, является Метод наименьших квадратов.

Метод наименьших квадратов – это статистическая процедура поиска наилучшего соответствия набора точек данных путем минимизации суммы ошибок или невязок точек на построенной линии.

Подогнанная линия регрессии позволяет нам предсказать отклик Y` для заданного значения X, используя:

Y’ = bX + A

Как в приведенном выше уравнении определить значения точки пересечения (A) и наклона для нашей линии регрессии (b)? Если бы нам пришлось провести линию через точки данных вручную, мы попытались бы провести линию, которая в целом сводит к минимуму ошибки. Но когда мы подгоняем линию через данные, некоторые из наблюдаемых значений (Y) будут больше, чем их предсказанное значение (Y`) (они упадут выше линии), а некоторые из наблюдаемых значений (Y) будут меньше. чем их предсказанные значения (Y`) (они упадут ниже линии).

Эта разница в наблюдаемых и прогнозируемых значениях называется ошибками прогнозирования и рассчитывается как:

E = Y — Y`

Если мы сложим все ошибки, сумма будет равна нулю. Так как же измерить общую ошибку? Давайте воспользуемся простым трюком: возведем ошибки в квадрат и найдем линию, которая минимизирует эту сумму квадратов ошибок, как показано ниже:

Этот метод, метод наименьших квадратов, находит значения точки пересечения и наклона, которые минимизируют сумму квадратов ошибок и, таким образом, дают нам наиболее точное уравнение прямой.