Ограниченность человеческой памяти была проблемой для обработки огромных объемов информации. Хотя люди могут читать и понимать текст, их способность сохранять и вспоминать информацию по-прежнему ограничена, а навыки человеческого чтения не могут масштабироваться. В результате, машинное понимание чтения (MRC) появилось в ответ на увеличение объема информации. MRC включает в себя обучение машин читать и понимать текст на естественном языке, а затем отвечать на вопросы об этом тексте. Он также может извлекать ценную информацию из больших объемов неструктурированных данных, таких как новостные статьи, текстовые документы или веб-страницы. MRC позволяет искать и отвечать на вопросы по любым текстам, независимо от длины, стиля, предметной области и т. д.

Текущий подход к MRC предполагает использование машинного обучения, например, моделей глубокого обучения, нейронных сетей и т. д. Подход машинного обучения можно рассматривать как «черный ящик». Мы не можем понять, почему машина дает такой ответ и такую уверенность в счете. Хотя очень немногие поддерживают прозрачность с некоторой степенью детализации, например, объясняя результаты, выделяя слова, которые способствовали прогнозу.

На самом деле, было обнаружено, что многие существующие модели MRC достигают производительности, подобной человеческим, с помощью быстрых решений, вместо реального понимания текста.

В настоящее время мы преследуем обещание того, что мы назвали «грамотной разведкой» (LI), то, что в других местах назвали «MRC» или даже «документальной разведкой» (DI), но мы отделяемся от них, и мы делать что-то на наших условиях. Мы можем поддерживать полную прозрачность на каждом уровне (чтобы знать, что происходит в любой момент). Это может произойти с нашей собственной запатентованной технологией, называемой «канонической моделью», также известной как расширенные топологические сети, новая символическая парадигма для реализации рассуждений на естественном языке.

Нейронная сеть (NN) и машинное обучение (ML) моделируют только закономерности, основанные на статистике, но не знают, почему что-то имеет для них «смысл» или нет. Напротив, наш ЛИ понимает, что происходит и почему, потому что логика закодирована в «канонической модели». Помимо общих задач MRC, которые поддерживаются другими движками, таких как суммирование текста или ответы на вопросы, наш движок сможет выполнять логические выводы.

В отличие от других, наш движок будет иметь настоящую когнитивную способность, связанную с семантикой (значением). Пользователи могут немедленно развернуть использование новых знаний без переобучения или повторного развертывания всей системы, в отличие от текущих подходов к машинному обучению.

Начиная с нашей запатентованной канонической модели, мы начинаем читать некоторый текст в знакомой нам структуре. Например, мы могли бы прочитать спецификацию, которая заполнена плотным набором информации, организованной для человеческого глаза в виде таблиц. Это основные цели для LI, поскольку человек, который хотел бы найти какую-то информацию в этом типе документа, легко разочаровывается. Если все, что у них есть, — это текстовый поиск по некоторым конкретным ключевым словам, никто и близко не гарантирует, что вы найдете правильное представление о том, что вы ищете.

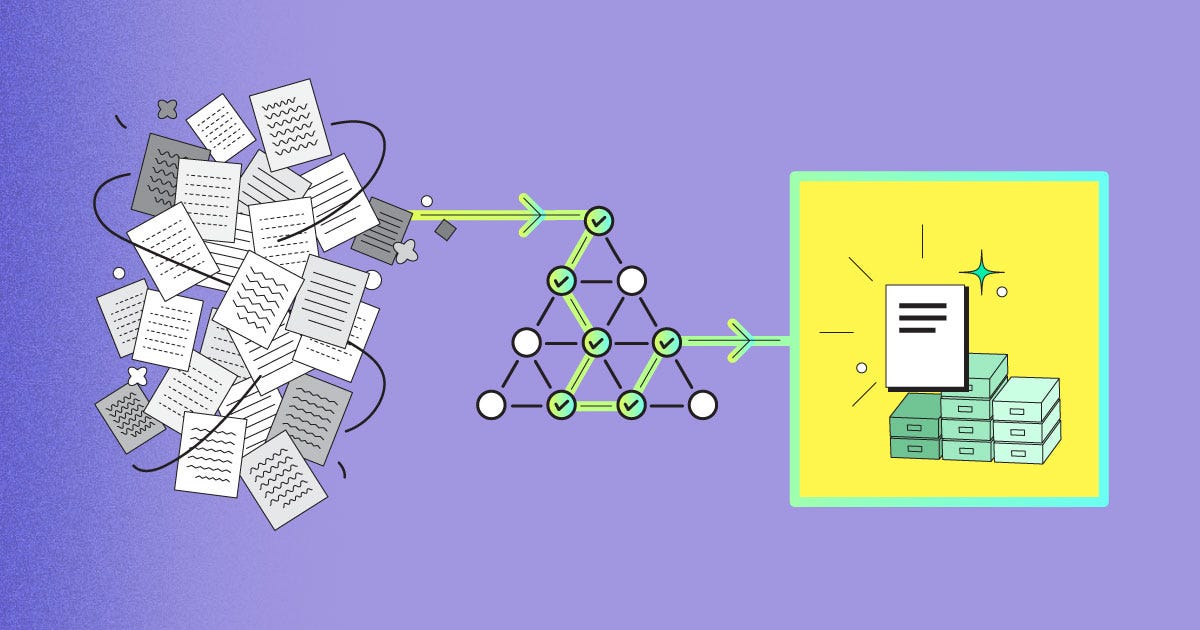

При нашем прочтении корпуса из-за природы нашей модели, когда неструктурированный текст организован в канонические структуры, он естественным образом выстраивается в структурированную логическую структуру. Наше использование онтологии заполняет щели между идеями, поэтому можно сделать вывод о вещах, которые не имеют непосредственного отношения к делу. Вам не обязательно точно знать, что вы ищете. Если бы вы это сделали, может быть, вам не нужно было бы так сильно стараться? Итак, будучи логическими формами, мы можем найти точный текст с фразой, которая связана с ней каким-то логическим образом, а не какое-то конкретное слово или фразу.

Мы разрабатываем движок, трансформируя мировые знания (или онтологию) в виде естественного языка в нашу каноническую модель, из неструктурированного в структурированный формат данных. Поскольку мы имеем дело с естественным языком, известно, что основные проблемы связаны со сложностью и изменчивостью естественного языка, то есть с тем, как стандартизировать их, чтобы они соответствовали нашей модели. На начальном этапе нам также требуется время и человеческие усилия для проверки правильности данных и построения онтологии вручную.

Как только мы сможем подогнать естественный язык к нашей модели и у нас будет достаточно онтологии в нашей базе данных с входными данными в форме естественного языка, мы ожидаем, что машина автоматически проверит правильность, проверив, не противоречит ли новая введенная онтология новой. доступной онтологии и иметь возможность подключаться или создавать отношения с доступной онтологией.

Поскольку будет добавляться все больше и больше онтологий, движок сможет обнаруживать новую логику или даже делать новое научное открытие. Движок также способен идентифицировать релевантную информацию в тексте и отвечать на вопросы.

Несмотря на четкую цель и конкретный план, поскольку мы находимся на ранних стадиях разработки, предстоит еще много работы, особенно в решении проблем двусмысленности и изменчивости естественного языка. Более того, наш подход отличается от других. Будут проблемы, которые нужно обнаружить и решить на этом пути.

Спасибо за чтение

Пожалуйста, подпишитесь, чтобы быть в курсе наших эксклюзивных технологий искусственного интеллекта и интересных историй о незавершенном производстве. Кроме того, посетите mind.ai, чтобы узнать, насколько наш ИИ прозрачен, точен и надежен 🤓⚙️🤖🦾